Microsoft opracował nową wersję swojego modelu języka kodeków neuronowych, Vall-E, która przewyższa poprzednie wersje pod względem naturalności, możliwości mowy i podobieństwa do ludzi. Jest to pierwszy tego typu program, który osiągnął równość z ludźmi w dwóch popularnych benchmarkach i najwyraźniej jest tak realistyczny, że Microsoft nie planuje udostępniać go publicznie.

Wykorzystując podstawy Vall-E, nowe narzędzie głosowe AI integruje dwa główne ulepszenia, które znacznie poprawiają jego wydajność. Modelowanie kodu grupowego pozwala firmie Microsoft lepiej organizować kodeki, co skutkuje krótszymi długościami sekwencji, zwiększając szybkość wnioskowania i pomagając pokonać wyzwania związane z modelowaniem długich sekwencji.

Microsoft opracował nową wersję swojego modelu języka kodeków neuronowych, Vall-E, która przewyższa poprzednie wersje pod podobieństwa do ludzi.

Tymczasem próbkowanie uwzględniające powtórzenia zmienia pierwotny proces próbkowania jądra, aby podczas dekodowania szukać powtórzeń tokenów. Microsoft powiedział, że ten proces pomaga ustabilizować dekodowanie i zapobiega problemowi z nieskończoną pętlą, który występował w oryginalnym Vall-E.

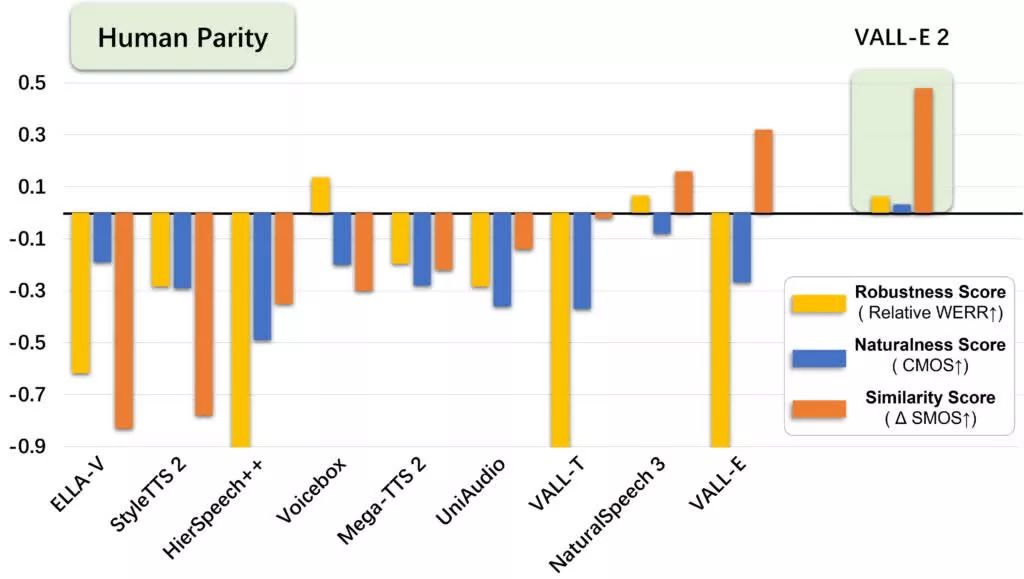

Microsoft poddał Vall-E 2 testom przy użyciu zbiorów danych LibriSpeech i VCTK i ten zdał je oba śpiewająco. Kiedy gigant z Redmond twierdzi, że narzędzie AI osiąga ludzki poziom, oznacza to, że Vall-E 2 działał lepiej niż próbki prawdy w zakresie rozbudowania, podobieństwa i naturalności. Innymi słowy, narzędzie może generować naturalną mowę, która jest praktycznie identyczna z oryginalnym mówcą.

Microsoft udostępnił dziesiątki próbek z Vall-E 2, które można znaleźć na stronie podsumowującej projekt. Rzeczywiście, próbki Vall-E 2 są niezwykle realistyczne i nie do odróżnienia od ludzkiego mówcy. Narzędzie AI opanowało nawet subtelności, takie jak kładzenie nacisku na właściwe słowo w zdaniu tak, jak ludzie podświadomie robią to podczas mówienia.

Microsoft powiedział, że Vall-E 2 jest wyłącznie projektem badawczym, dodając, że nie ma planów włączenia tej technologii do jakiegoś produktu konsumenckiego lub udostępnienia narzędzia publicznie. Producent zauważył również, że niesie to ze sobą potencjalne ryzyko niewłaściwego użycia, takiego jak podszywanie się pod konkretną osobę lub fałszowanie identyfikacji głosowej.

Firma uważa jednak, że może on znaleźć zastosowanie między innymi w edukacji, tłumaczeniach, dostępności, dziennikarstwie, samodzielnie tworzonych treściach i chatbotach.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Generator mowy AI od Microsoftu osiąga ludzki poziom, więc nie zostanie upubliczniony