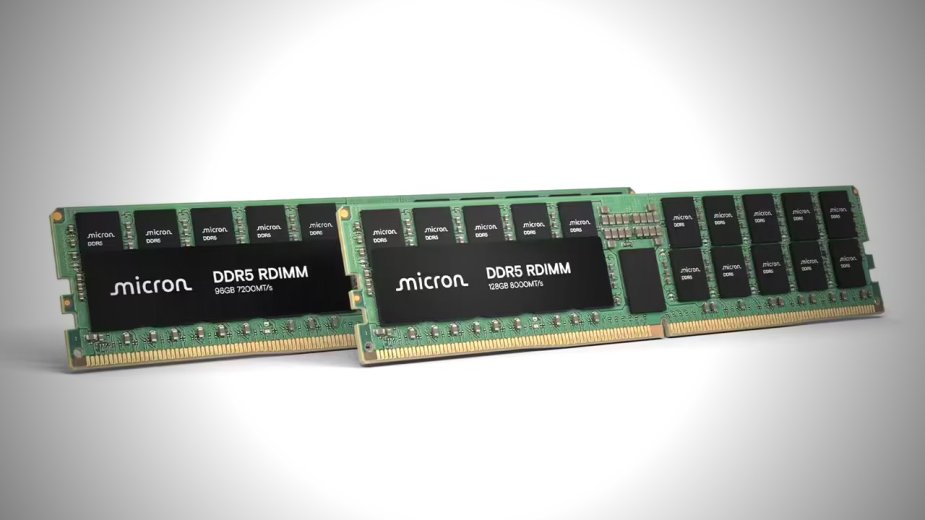

Micron zaprezentował nowe pamięci DDR5 RDIMM o pojemności 256 GB osiągające prędkości 9200 MT/s. Producent kieruje nowy produkt głównie do serwerów obsługujących sztuczną inteligencję, duże modele językowe oraz centra danych wymagające bardzo wysokiej przepustowości pamięci i niższego zużycia energii.

Nowe moduły zostały zbudowane w oparciu o technologię DRAM 1 gamma i wykorzystują rozwiązania związane z trójwymiarowym układaniem pamięci oraz połączeniami TSV. W praktyce chodzi o bardziej zaawansowaną konstrukcję pozwalającą zwiększyć pojemność i szybkość bez konieczności drastycznego zwiększania rozmiaru modułu.

Wydajność wyższa nawet o 40%

Micron twierdzi, iż nowe pamięci osiągają ponad 40% wyższą wydajność względem modułów DDR5 RDIMM, które są obecnie szeroko wykorzystywane w serwerach produkcyjnych. To istotna różnica szczególnie dla firm rozwijających rozwiązania AI działające w czasie rzeczywistym, gdzie przepustowość pamięci zaczyna mieć równie duże znaczenie jak moc procesora czy akceleratorów GPU.

Micron zaprezentował nowe pamięci DDR5 RDIMM o pojemności 256 GB osiągające prędkości 9200 MT/s. Producent kieruje nowy produkt głównie do serwerów obsługujących sztuczną inteligencję, duże modele językowe oraz centra danych wymagające bardzo wysokiej przepustowości pamięci i niższego zużycia energii.

Serwery mogą obsłużyć większe modele AI i większą liczbę użytkowników przy jednoczesnym ograniczeniu poboru energii oraz liczby modułów instalowanych w jednej maszynie.

Lepsza energooszczędność

Pojedyncza pamięć 256 GB może zużywać ponad 40% mniej energii niż dwa moduły 128 GB oferujące tę samą łączną pojemność. W centrach danych przekłada się to na niższe koszty chłodzenia oraz mniejsze zapotrzebowanie na energię elektryczną, a właśnie te elementy zaczynają dziś najmocniej wpływać na koszty utrzymania infrastruktury AI.

To kolejny sygnał pokazujący, że rozwój sztucznej inteligencji coraz mocniej wpływa już nie tylko na rynek kart graficznych, ale również pamięci RAM i całych platform serwerowych.

W porównaniu z obecnie popularnymi modułami DDR5 RDIMM działającymi z prędkościami około 6400 MT/s lub 7200 MT/s nowa propozycja Microna wygląda jak wyraźny krok naprzód, choć na razie będzie dostępna głównie dla największych klientów budujących zaawansowane centra danych.

Dla kogo nowe pamięci?

Firmy rozwijające modele AI potrzebują dziś coraz większej ilości pamięci o bardzo wysokiej przepustowości, ponieważ same akceleratory GPU przestają być jedynym ograniczeniem wydajności. Dodatkowo branża próbuje ograniczać zużycie energii, które w nowoczesnych centrach danych rośnie bardzo szybko.

Najbardziej skorzystają hyperscalerzy, operatorzy chmur i firmy budujące infrastrukturę HPC, ale pośrednio takie zmiany wpływają też na zwykłych użytkowników, ponieważ mogą przyspieszyć rozwój usług AI i skrócić czas działania modeli generatywnych. Trudno nie odnieść wrażenia, iż pamięci pokazane przez Microna są spore i trudno byłoby je zmieścić w kompaktowej obudowie.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Micron pokazuje nowe pamięci DDR5 dla AI. Serwery mają być szybsze i oszczędniejsze