"Rasistowska" sztuczna inteligencja (AI) nie tylko wprowadza w błąd, ale może być również szkodliwa, powodując negatywne skutki dla ludzi. Taki alarm został ogłoszony przez doktora Gideona Christiana, asystenta profesora na Wydziale Prawa Uniwersytetu Alberty, w oświadczeniu prasowym wydanym przez tę instytucję.

Dr. Christian jest również beneficjentem grantu w wysokości 50 000 USD przyznanego przez Biuro Komisarza ds. Prywatności na projekt badawczy o nazwie "Łagodzenie wpływu technologii rozpoznawania twarzy AI na rasę, płeć i prywatność." Ta inicjatywa ma na celu zbadanie aspektów związanych z rasą w technologii rozpoznawania twarzy opartej na sztucznej inteligencji w Kanadzie. Dr. Christian jest uważany za eksperta w dziedzinie sztucznej inteligencji i prawa.

"Istnieje błędne przekonanie, że technologia, w przeciwieństwie do ludzi, jest wolna od stronniczości. To nieprawda" - stwierdził dr. Christian.

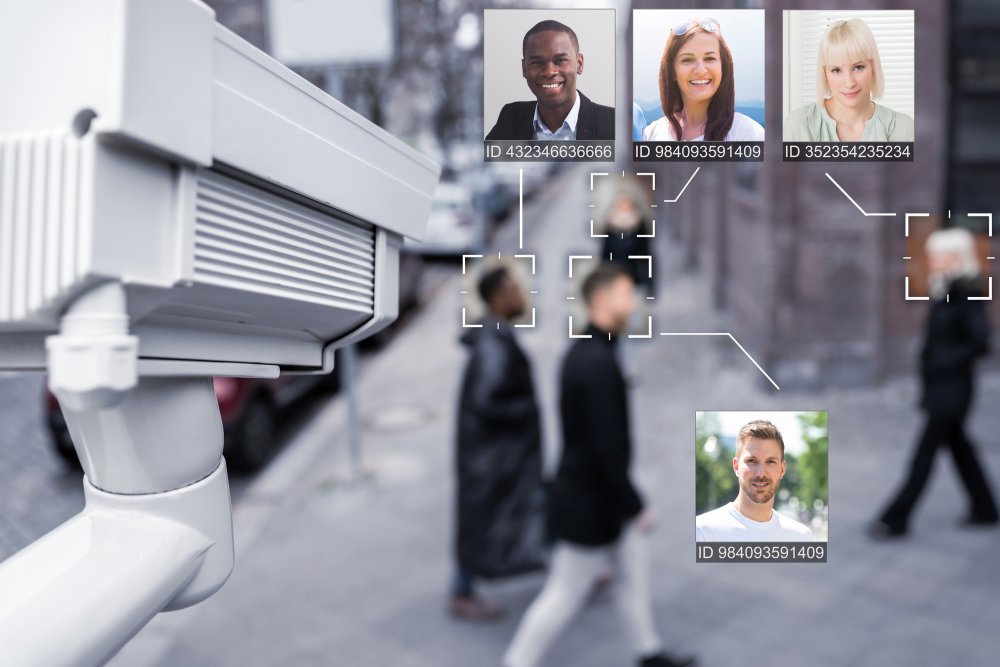

Ostrzegł on, że w szczególności technologia rozpoznawania twarzy jest szkodliwa dla osób kolorowych. "Wykazano, że technologia może powielać ludzkie uprzedzenia. W niektórych technologiach rozpoznawania twarzy wskaźnik dokładności rozpoznawania twarzy białych mężczyzn wynosi ponad 99 procent. Ale niestety, jeśli chodzi o rozpoznawanie twarzy kolorowych, zwłaszcza twarzy czarnoskórych kobiet, technologia wydaje się wykazywać najwyższy poziom błędu, który wynosi około 35 procent" - wyjaśnił Christian. "Technologia rozpoznawania twarzy może błędnie dopasować twoją twarz do twarzy innej osoby, która mogła popełnić przestępstwo. Wszystko, co widzisz, to policja pukająca do drzwi, aresztująca cię za przestępstwo, którego nigdy nie popełniłeś".

"Wiemy, że technologia ta jest wykorzystywana przez różne departamenty policji w Kanadzie. Możemy przypisać brak podobnych przypadków do tych w USA w oparciu o fakt, że technologia ta jest potajemnie wykorzystywana przez kanadyjską policję. Tak więc zapisy mogą nie istnieć, a jeśli istnieją, mogą nie zostać upublicznione" - powiedział. "To, co widzieliśmy w Kanadzie, to przypadki (czarnoskórych kobiet), imigrantek, które z powodzeniem złożyły wnioski o nadanie statusu uchodźcy, a ich status został odebrany na podstawie tego, że technologia rozpoznawania twarzy dopasowała ich twarz do innej osoby. Dlatego też, jak twierdzi rząd, złożyły one wnioski, używając fałszywych tożsamości. Należy pamiętać, że są to czarnoskóre kobiety - ta sama grupa demograficzna, w której ta technologia ma najwyższy wskaźnik błędów".

Christian wyjaśnił, że technologia nigdy nie jest z natury stronnicza, ale winne są dane wykorzystywane do szkolenia algorytmów uczenia maszynowego. Technologia będzie generować wyniki zgodnie z tym, czym jest karmiona.

"Większość z nas chce żyć w społeczeństwie wolnym od uprzedzeń rasowych i dyskryminacji" - powiedział Christian. "To jest sedno moich badań, szczególnie w obszarze sztucznej inteligencji. Nie sądzę, abyśmy chcieli sytuacji, w której uprzedzenia rasowe, z którymi tak ciężko walczyliśmy, są teraz subtelnie utrwalane przez technologię sztucznej inteligencji".

Profesor zauważył, że pod wieloma względami jest to stary problem podszywający się pod nową kwestię. Ostrzegł, że jeśli się nim nie zajmie, może zniszczyć lata postępu.

"Uprzedzenia rasowe nie są niczym nowym" - zauważył. "Nowością jest to, jak te uprzedzenia przejawiają się w technologii sztucznej inteligencji. A ta technologia - i ten konkretny problem z tą technologią, jeśli nie będzie kontrolowany - może zniweczyć cały postęp, jaki osiągnęliśmy w wyniku ruchu na rzecz praw obywatelskich".

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Technologia AI jest rasistowska wobec czarnoskórych i może zniszczyć postęp w tolerancji