W 2016 roku zasady projektowania układów graficznych wciąż były z grubsza takie same jak na początku ery zunifikowanych shaderów, która rozpoczęła się w 2006 roku. Czyli każda kolejna generacja typowo miała coraz więcej jednostek wykonawczych każdego rodzaju, czasem poszerzana była szyna pamięci, w architekturach wprowadzane były dalsze ulepszenia pod kątem efektywności, a zmiany litografii, gdy już następowały, przynosiły spory skok upakowania tranzystorów. Jedynym wyzwaniem dla producentów GPU była w tym okresie teselacja, wprowadzona wraz z DirectX 11, która wymagała odpowiednio mocnych teselatorów.

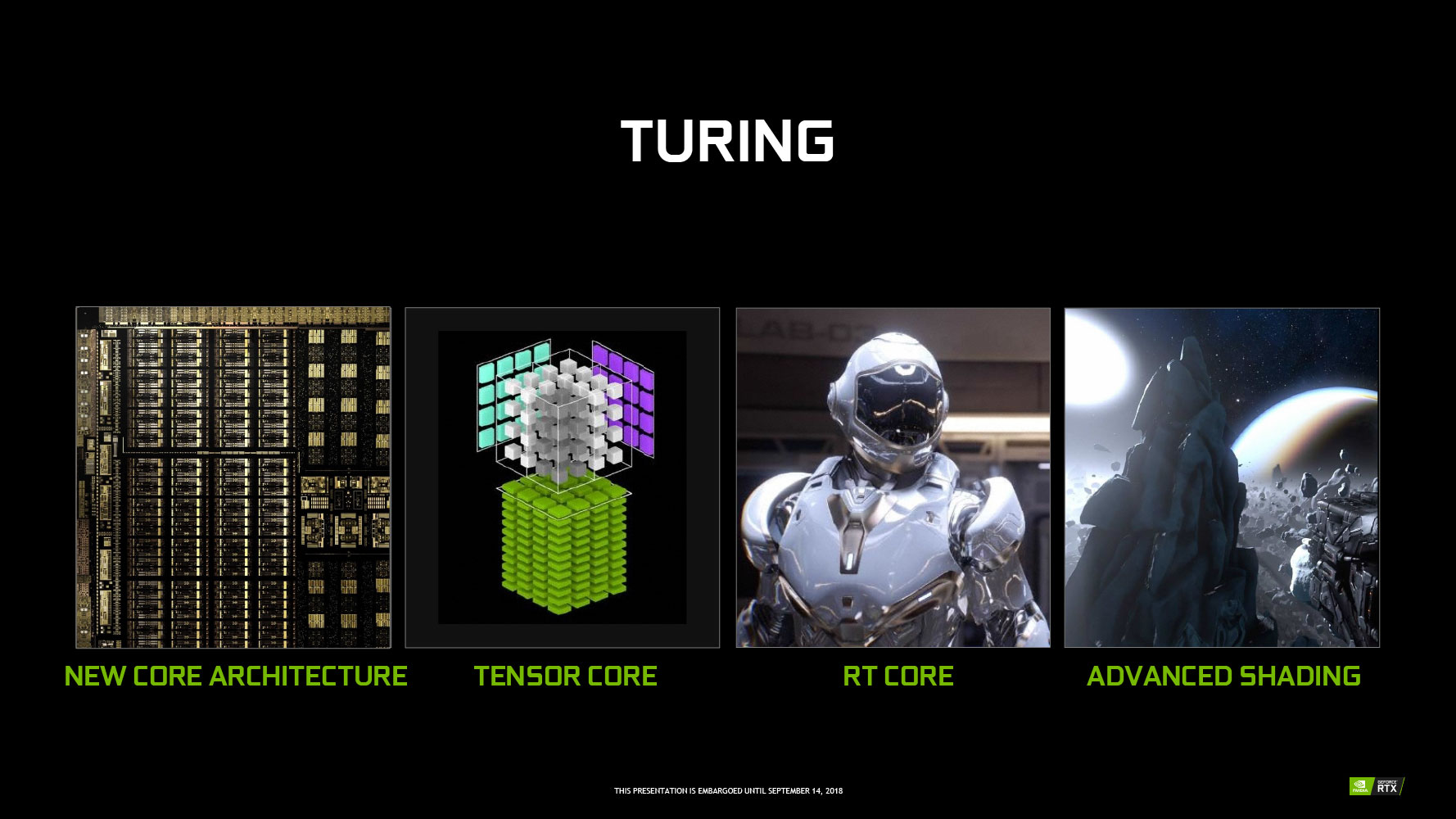

Wszystko zmieniło się w 2018 roku, kiedy NVIDIA wypuściła układy graficzne z rodziny GeForce RTX 20 na architekturze Turing. Zieloni postawili w tej generacji na śledzenie promieni oraz sztuczną inteligencję, czego sprzętowym przejawem były nowe rodzaje jednostek wykonawczych w GPU, czyli tzw. rdzenie RT oraz rdzenie Tensor. To nowe podejście zmieniło sposób, w jaki patrzymy na karty graficzne. Obecnie, wybierając GPU, interesuje nas nie tylko wydajność w rasteryzacji czy pobór prądu, ale często także to, jak dany układ radzi sobie po włączeniu RT lub PT, oraz niemal zawsze to, jakie "wspomagacze" wydajności obsługuje, i jaka jest jakość tych technik podnoszących FPS.

Czy śledzenie promieni w grach to dobry pomysł?

W związku z tak istotnymi zmianami warto się zastanowić, czy rynek na pewno poszedł w dobrą stronę. Opinia na ten temat to kwestia indywidualna, gdyż przez lata widziałem masę argumentów za oraz przeciw, z którymi czasem się zgadzałem, a czasem nie. Osobiście, jeżeli chodzi o śledzenie promieni, uważam że postawienie na to rozwiązanie było krokiem w dobrą stronę, gdyż nad tradycyjnymi technikami renderowania branża pracowała już tyle lat, że pójście o krok do przodu, gdy wreszcie stało się to technicznie wykonalne, było oczywistością.

I tak, wiem doskonale, że RT oraz PT to ogromny wzrost wymagań sprzętowych, który wymusza po aktywacji tych opcji skorzystanie także z rozwiązań podnoszących wydajność jak DLSS czy FSR, ale przynajmniej w niektórych grach różnica wizualna jest znaczna, a co najważniejsze, twórcy gier przecież nie zmuszają graczy, aby włączali śledzenie promieni czy śledzenie ścieżek. Jeżeli dla kogoś koszt wydajnościowy jest niewspółmierny do różnicy w oprawie, to wystarczy zostawić RT/PT wyłączone. Przy czym warto dodać, że pojawiło się kilka tytułów, np. Indiana Jones i Wielki Krąg, które od podstaw zostały zbudowane wokół śledzenia promieni, którego wyłączyć nie można, ale te produkcje mają bardzo lekką obligatoryjną implementację RT, która dobrze działa nawet na najsłabszych GPU obsługujących śledzenie promieni, więc to też nie jest istotny problem.

Skalery obrazu stały się normą w nowych grach

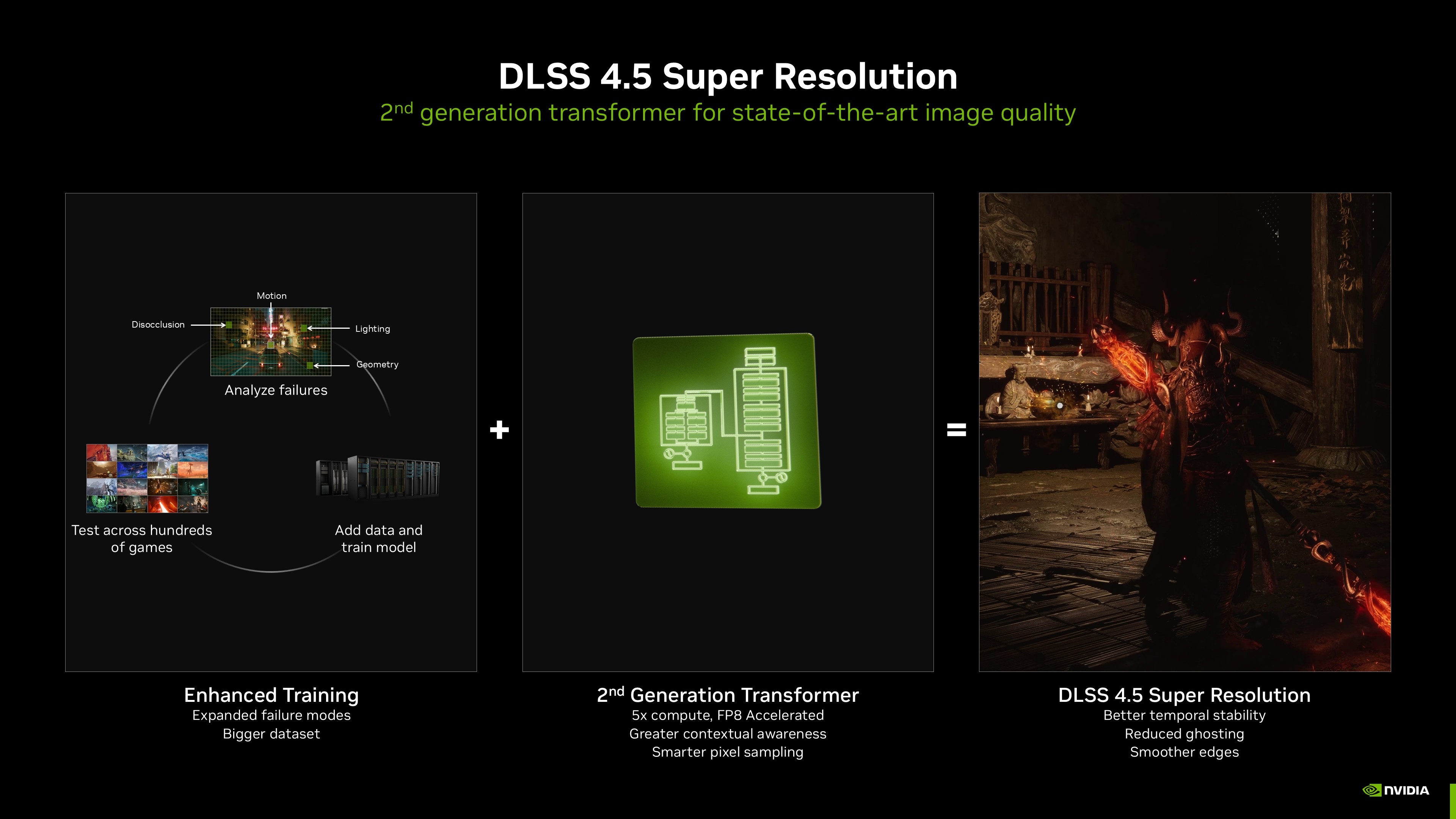

Trochę inne jest moje podejście, jeżeli chodzi o "wspomagacze" wydajności, gdzie mamy dwa zupełnie różne rozwiązania: skalowanie obrazu oraz generowanie klatek. Wprowadzenie skalerów oceniam pozytywnie, szczególnie po tylu latach ich dopracowywania, dzięki czemu najnowsze generacje tych technik, tzn. DLSS 4, FSR 4 oraz XeSS 2, oferują wysokiej jakości obraz przy sporym wzroście liczby FPS.

Są one tym bardziej przydatne, że wiele nowych gier, szczególnie tych na silniku Unreal Engine 5, ma bardzo słabą implementację natywnych technik wygładzania krawędzi, co sprawia, że przy renderingu natywnym grafika jest niezwykle niestabilna, a problem ten rozwiązują lub przynajmniej zmniejszają jego widoczność właśnie skalery obrazu. Te ostatnie mają także tryb natywny, po włączeniu którego zajmują się wyłącznie wygładzaniem krawędzi, co jest dobrym rozwiązaniem dla osób, które wolą poświęcić osiągi na rzecz jeszcze lepiej wyglądającej oprawy. Innymi słowy, choć krytykujących np. DLSS nie brakuje, to nie uważam, by było to zasadne podejście, gdyż obecnie są to naprawdę użyteczne rozwiązania.

Generatory klatek i kontrowersyjny marketing

Ale odnośnie generatorów klatek mam poważne wątpliwości, nie w sferze technicznej, a od strony marketingu. Najlepszy dowód na nadużycia ze strony PR-owców mieliśmy przy premierze serii GeForce RTX 50, kiedy sam prezes NVIDII ogłosił na scenie, że RTX 5070 zaoferuje wydajność RTX-a 4090. Później okazało się, że podczas wykonanych przez zielonych testów starszy układ miał włączone generowanie jednej klatki na każdą wyrenderowaną, a nowszy... trzech. W takich warunkach oba GPU rzeczywiście osiągają podobną liczbę FPS, ale bynajmniej nie oznacza to, że całościowo ich wydajność oraz jakość obrazu są wtedy takie same.

Osiągi to nie tylko klatki na sekundę, ale także opóźnienie platformy, a niższą latencję zapewnia RTX 4090, z uwagi na wyższy bazowy FPS przed włączeniem generatora. Starszy układ ma także przewagę w jakości obrazu, gdyż im wyższy mnożnik generatora klatek, tym większa widoczność artefaktów związanych z działaniem tej techniki, a na ich występowanie wpływ ma także bazowa wydajność, która oczywiście jest niższa dla RTX 5070, co tym bardziej zwiększa różnicę w jakości grafiki. Te wszystkie szczegóły, bardzo istotne zresztą, zostały przemilczane - dostaliśmy tylko slogan "4090 Performance". I w ten oto sposób użyteczna technika, która jednak ma swoje ograniczenia, została wykorzystania do marketingowych manipulacji, co budzi poważne obawy.

Kryptowaluty oraz sztuczna inteligencja

Co więcej, to nie jedyne wyzwania, z jakimi musieli lub muszą się mierzyć gracze. Karty graficzne to nie tylko narzędzie rozrywki, ale także bardzo wydajne maszynki do obliczeń, z czym wiążą się pewne zagrożenia. Chyba wszyscy pamiętają, jak za czasów GeForce'ów RTX 30 oraz Radeonów RX 6000 "górnicy" masowo wykupywali akceleratory do kopania kryptowalut, w efekcie czego ich ceny w sklepach wzrosły nawet kilkukrotnie. A obecnie, ponieważ GPU służą także do obliczeń związanych z AI, z uwagi na kryzys na rynku pamięci w pierwszej kolejności trafiają do centrów danych, zaś gracze dostają ochłapy. Dla osób zainteresowanych sztuczną inteligencją możliwość wykonywania takich zadań na swoim własnym komputerze ze zwykłą kartą graficzną z pewnością jest świetnym bonusem, ale jak widać, ostatecznie obróciło się to przeciw graczom.

Wreszcie pojawił się trzeci gracz na rynku GPU

Z pozytywnych rzeczy wskazać można z kolei na debiut Intela na rynku układów graficznych. Debiut co prawda dość trudny, z uwagi na pewne bolączki sprzętowe oraz programowe, ale jednak w końcu jest jakaś alternatywa dla AMD oraz NVIDII. Co więcej, niebiescy cały czas intensywnie pracują nad swoją ofertą GPU, a konkretnie druga generacja architektury Xe przyniosła solidne usprawnienia sprzętowe, zaś sterowniki Intela, choć wciąż dalekie od perfekcji, są coraz lepsze. Nie można również zaprzeczyć, że pewne rzeczy udały się niebieskim zaskakująco dobrze, chociażby ich implementacja śledzenia promieni oraz technika skalowania obrazu XeSS. Do prawdziwej rywalizacji z gigantami rynku GPU wciąż jeszcze daleka droga, ale kto wie, może pewnego dnia Intel będzie w stanie na poważnie z nimi powalczyć, czego oczywiście należy tej firmie życzyć, gdyż większa konkurencja to bardzo dobra rzecz dla konsumentów.

Przyszłość pod znakiem wyzwań z litografią

Reasumując, minione 10 lat przyniosło nowego gracza w temacie GPU, ale przede wszystkim zupełnie zmieniło sposób, w jaki patrzymy na karty graficzne oraz napędzające je układy. Kiedyś istotne były techniki wygładzania krawędzi jak MSAA, znacznie obniżające FPS, a teraz rządzą rozwiązania podnoszące wydajność, których jakość ma dla nabywców istotny wpływ. Tym bardziej, że wymagania gier stale rosną, stanowiąc coraz większe wyzwanie, w związku z czym te "dopalacze" osiągów robią istotną różnicę i wręcz stały się obowiązkowe.

Pozostaje tylko pytanie, czy kolejna dekada przyniesie równie duży postęp jak miniona, w czym niewątpliwie przeszkadzać będą coraz większe trudności we wprowadzaniu niższych litografii oraz związany z tym coraz wyższy ich koszt. Czy producenci GPU poradzą sobie z tym wyzwaniem, czy też wydajność układów i wymagania gier będą się coraz bardziej rozjeżdżać, a AMD, NVIDIA i Intel będą musieli ratować się coraz wyższymi mnożnikami generatorów klatek, to oczywiście pokażą nadchodzące lata.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

10 lat ewolucji układów graficznych - era obliczeń oraz AI