Jeśli jesteście graczami, którzy wypożyczają moc swojej karty graficznej firmie Salad zajmującej się przetwarzaniem w chmurze, to musicie wiedzieć, że istnieje duże prawdopodobieństwo, że zostanie ona wykorzystana do tworzenia treści porno przez sztuczną inteligencję.

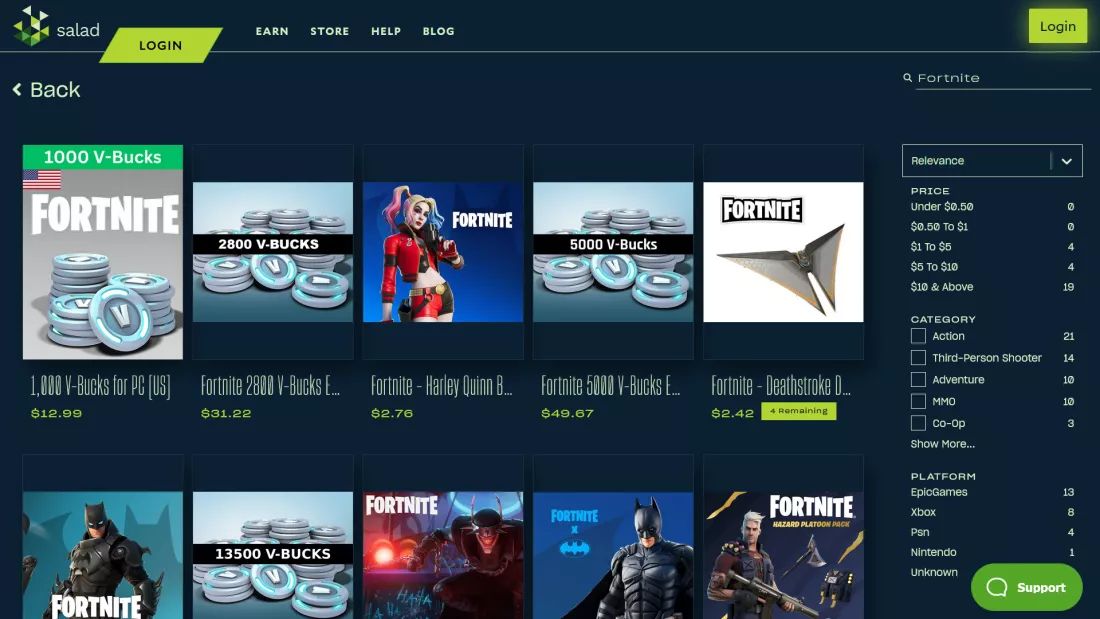

Według 404 Media firma Salad znalazła sprytny sposób na znaczne zwiększenie skali generowania treści AI, w tym obrazów, filmów i tekstu, poprzez zlecanie ciężkich prac obliczeniowych potężnym układom graficznym znajdującym się w platformach graczy. Użytkownicy, którzy zarejestrują się, aby „wynajmować” moc obliczeniową swoich GPU, otrzymają zapłatę w postaci towarów cyfrowych, takich jak dodatki kosmetyczne do Fortnite, środki do płacenia w Roblox, skórki Minecraft i inne nagrody związane z grami.

Salad znalazło sprytny sposób na znaczne zwiększenie skali generowania treści AI, poprzez wykorzystanie grafik znajdujących się w platformach graczy.

To łatwe pieniądze – mocne karty graficzne dobrze nadają się do uruchamiania modeli AI, takich jak Stable Diffusion, w celu generowania multimediów. Ale tu jest problem: część treści AI generowanych przez Salad przy użyciu wynajętej mocy GPU to treści pornograficzne.

Podczas rejestracji Salad daje użytkownikom możliwość rezygnacji z udziału w generowaniu treści dla dorosłych. Jednak moderatorzy Discorda należącego do firmy podobno potwierdzili, że domyślnie wszyscy mają włączoną tę opcję, a niektóre kraje nie pozwalają na taką zgodę ze względu na lokalne przepisy. Strona Salad sugeruje również, że użytkownicy, którzy nie generują treści dla dorosłych, mogą zarobić mniej pieniędzy. „Może się zdarzyć, że zarabiasz nieco mniej, jeśli mamy duże zapotrzebowanie na określone treści dla dorosłych, ale nie planujemy uczynić tych firm podstawą naszego modelu biznesowego” – czytamy w oficjalnym FAQ.

Jeszcze większy cień na Salad rzuca zaangażowanie firmy w Civitai, platformę, na której udostępniane są modele sztucznej inteligencji i generowane są obrazy. 404 Media zauważa, że Civitai już wcześniej zezwalała na generowanie materiałów pornograficznych bez zgody, co obejmuje jeden szczególnie niepokojący incydent, w którym obrazy wygenerowane przez sztuczną inteligencję „można było zaklasyfikować jako pornografię dziecięcą”.

Ani Salad, ani Civitai nie wyraziły się jasno na temat tego, jak powszechne jest nielegalne generowanie treści wśród publikowanych treści pornograficznych opartych na sztucznej inteligencji. Biorąc jednak pod uwagę historię Civitai i ogromną skalę mocy obliczeniowej, z której korzysta Salad, jest całkiem możliwe, że na bazie wynajmowanej przez graczy mocy obliczeniowej ich kart graficznych tworzone są nielegalne treści.

To mało przyjemna sytuacja, pokazująca problemy pojawiające się w komercyjnym rozwoju sztucznej inteligencji – firmy rozszerzają działania bez odpowiednich zabezpieczeń, przejrzystości i środków w zakresie odpowiedzialności. 404 Media spekuluje, że Salad domyślnie oznacza wszystkie zadania obrazów Stable Diffusion jako „treści dla dorosłych”, ponieważ w rzeczywistości nie może zweryfikować, co generują poszczególni użytkownicy.

Ewidentnie potrzebne są przemyślane regulacje, które ukrócą tego rodzaju samowolę firm, wykorzystujących nieświadomych użytkowników.

Pokaż / Dodaj komentarze do: Gracze użyczają swoich grafik do generowania porno przez AI w zamian za skórki Fortnite