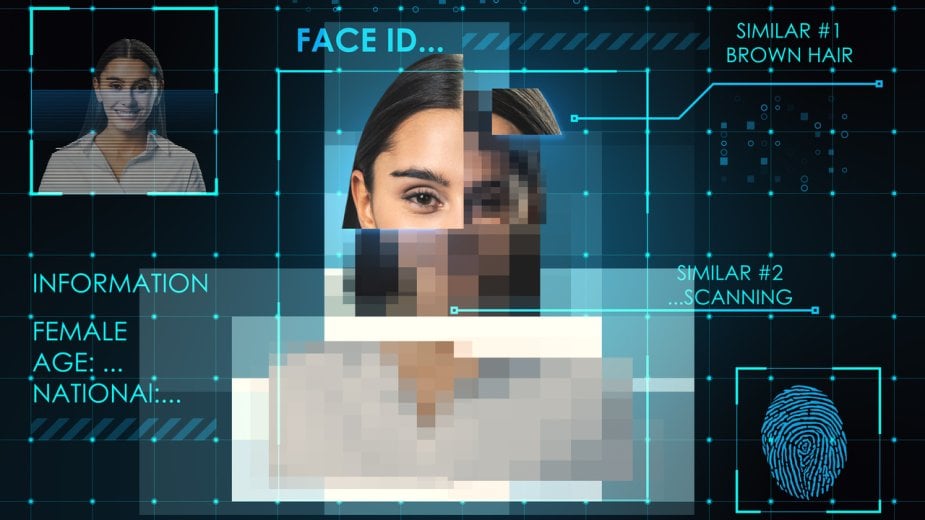

W dobie rosnącego zagrożenia fałszywymi treściami Honor zapowiedział globalne wdrożenie swojego narzędzia opartego na sztucznej inteligencji do wykrywania deepfake'ów. Technologia ta ma zostać oficjalnie udostępniona w kwietniu 2025 roku i będzie miała na celu ochronę użytkowników przed zmanipulowanymi obrazami oraz filmami, które mogą być wykorzystywane do dezinformacji i oszustw.

Deepfake'i, czyli fałszywe treści generowane przez AI, stają się coraz większym zagrożeniem dla społeczeństwa. Dzięki bardziej zaawansowanym algorytmom AI, manipulacje wideo oraz audio są trudniejsze do wykrycia gołym okiem. Mogą one być wykorzystywane do rozpowszechniania fałszywych informacji, oszustw finansowych czy nawet ingerencji w politykę.

Honor ułatwi wykrywanie deepfake'ów

Marka Honor zamierza udostępnić globalnie specjalne narzędzie oparte na sztucznej inteligencji do wykrywania zmanipulowanych treści. Pierwsze informacje na temat tej technologii zostały zaprezentowane podczas targów IFA 2024, a teraz firma planuje jej wdrożenie na szeroką skalę.

System Honora opiera się na analizie obrazu i dźwięku w czasie rzeczywistym, wykrywając oznaki manipulacji w filmach oraz zdjęciach. Algorytmy AI analizują różne aspekty treści cyfrowych, w tym:

- Rozmycie i artefakty wizualne – deepfake'i często posiadają nienaturalne przejścia między pikselami lub rozmycia w określonych obszarach twarzy

- Nieprawidłowe cieniowanie i oświetlenie – AI wykrywa anomalie w oświetleniu, które mogą zdradzać fałszywe wygenerowanie obrazu

- Zniekształcone cechy twarzy – analiza obejmuje proporcje twarzy, które w deepfake'ach mogą być lekko zaburzone

- Nieprawidłowe ruchy ust i oczu – narzędzie analizuje synchronizację mimiki i dźwięku w filmach

- Inne anomalie w klatkach wideo – AI wychwytuje niespójności w ruchach obiektów i osób

Jeśli system wykryje potencjalną manipulację, użytkownik otrzyma ostrzeżenie informujące, że dana treść może być sfałszowana.

Wdrożenie globalne i przyszłość technologii Honora

Honor zapowiada, że ich system będzie dostępny globalnie, a firma zamierza współpracować z organizacjami zajmującymi się cyberbezpieczeństwem oraz mediami społecznościowymi, aby skutecznie wykrywać i oznaczać zmanipulowane treści.

Więcej szczegółów na temat tej technologii zostanie ujawnionych podczas Mobile World Congress (MWC) 2025, który odbędzie się w Barcelonie.

Pokaż / Dodaj komentarze do: Wykrywanie Deepfake'ów stanie się łatwiejsze. Koniec z oszustwem "na chorego Brada Pitta"?