Intel odpowiedział na twierdzenia AMD dotyczące wydajności sztucznej inteligencji w centrach danych dla procesorów EPYC Turin piątej generacji, twierdząc, że CPU Xeon piątej generacji są szybsze przy odpowiednich optymalizacjach.

Na targach Computex 2024 firma AMD oficjalnie ogłosiła rodzinę procesorów EPYC piątej generacji o nazwie kodowej Turin, która wykorzystuje najnowszą architekturę rdzeni Zen 5. Firma chwaliła się wydajnością, porównując swoje nowe produkty z rodziną procesorów Intel Xeon piątej generacji o nazwie kodowej Emerald Rapids, szczególnie w zakresie obciążeń związanych z przepustowością AI. Teraz Intel wyjaśnił, że te benchmarki przeprowadzono bez odpowiednich optymalizacji dla Xeonów, a po ich wdrożeniu CPU piątej generacji powinny z łatwością pokonać najnowsze serwerowe układy EPYC (Turin) pod względem wydajności AI.

Intel przekonuje, że CPU Xeon piątej generacji są wydajnijesze od układów AMD EPYC Tutin przy odpowiednich optymalizacjach.

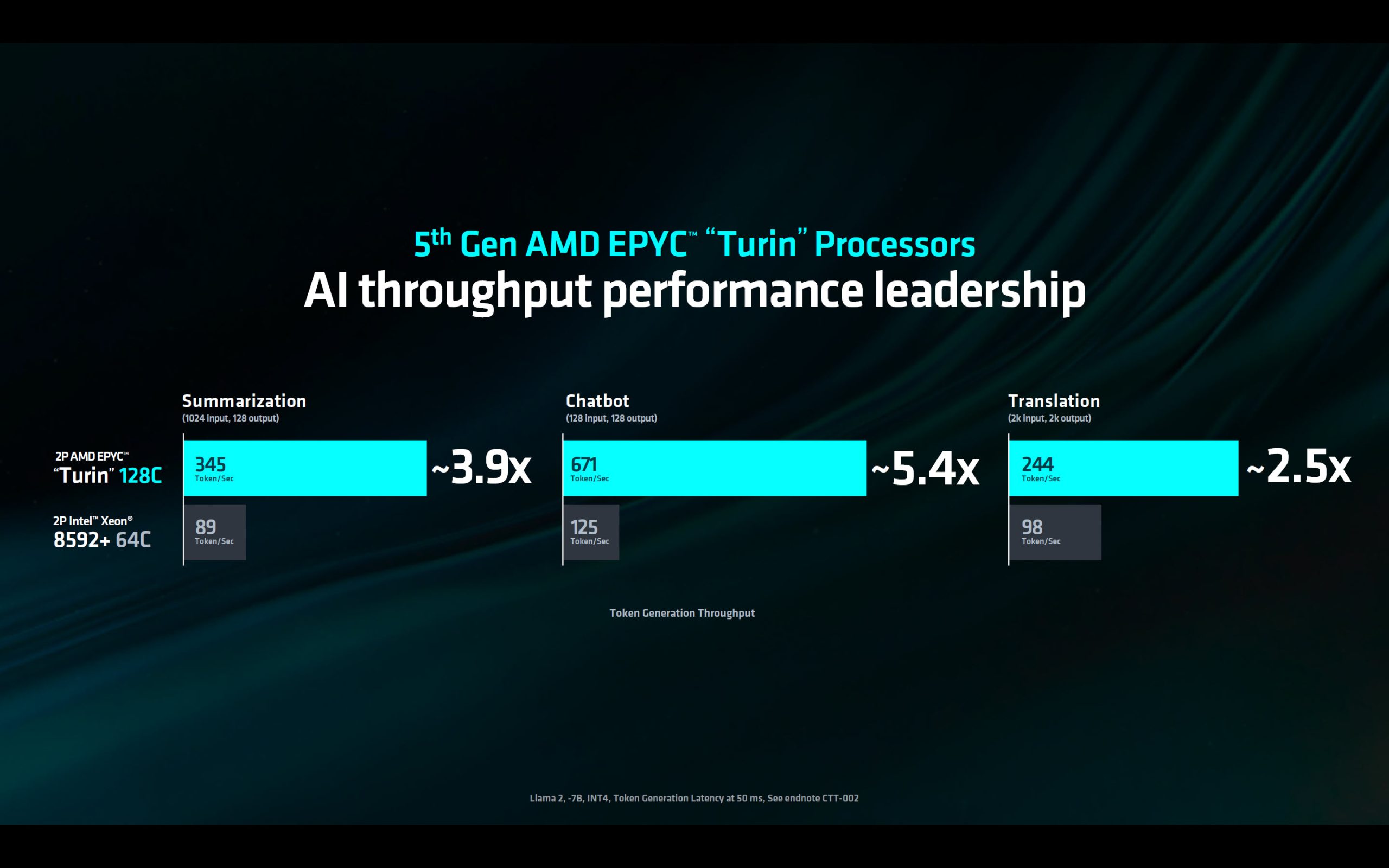

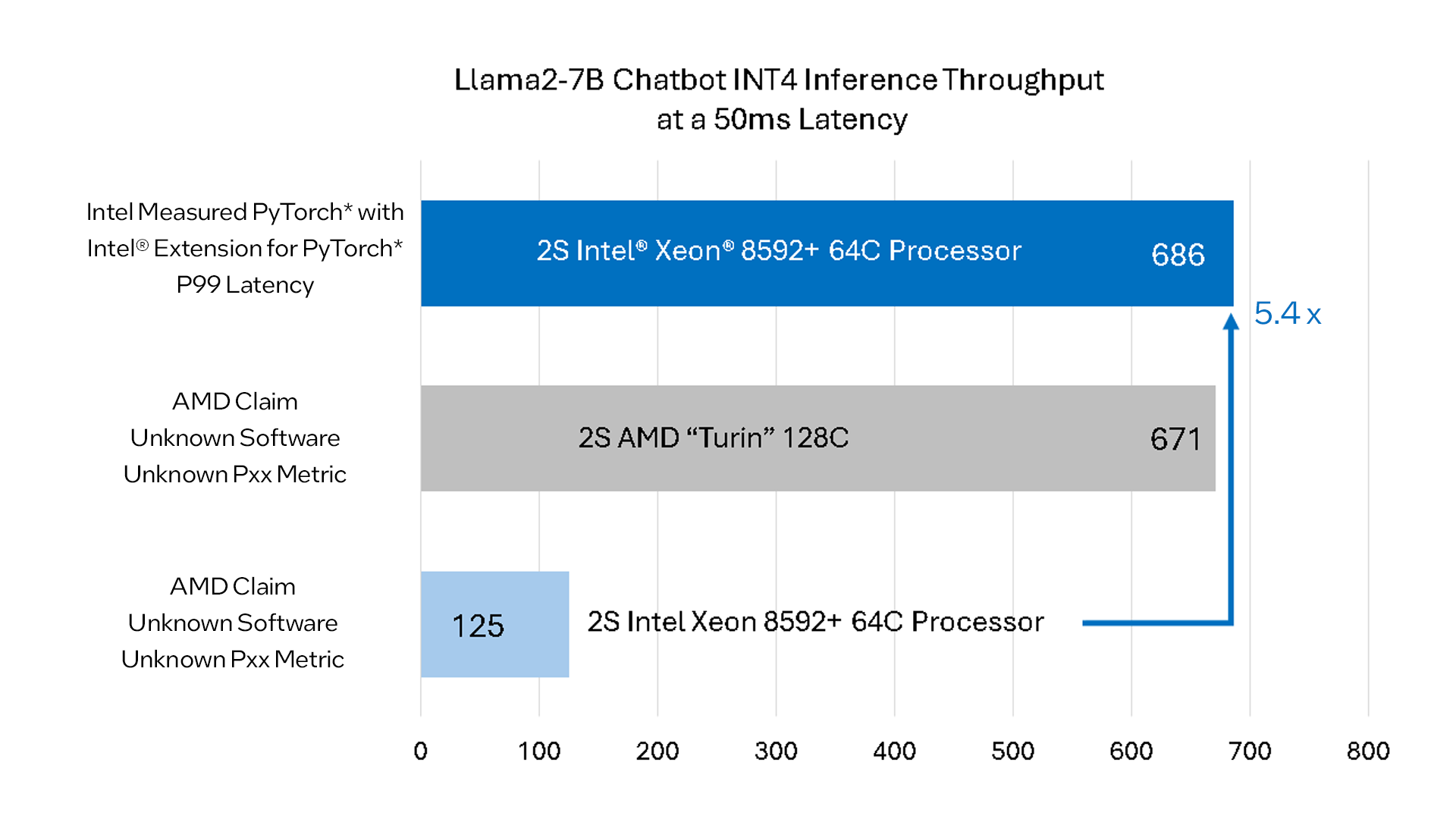

Testem, który został specjalnie podkreślony przez Intela, jest Chatbot Llama2-7B, który opiera się na przepustowości wnioskowania INT4 i benchmark został przeprowadzony przy opóźnieniu 50 ms. AMD chwaliło się, że procesory Intel EPYC piątej generacji w konfiguracji 2S (dwa gniazda) ze 128 rdzeniami każdy oferują do 671 tokenów/s wydajności, podczas gdy procesory Intel Xeon Platinum 8592+ piątej generacji z 64 rdzeniami każdy pracujące w tej samej konfiguracji z podwójnym gniazdem zapewniają tylko 125 tokenów/s. Oznaczało to ogromną 5,4-krotną przewagę procesorów AMD EPYC z rodziny Turin.

Intel twierdzi, że testy przeprowadzono bez odpowiedniego pakietu oprogramowania dla jednostek Xeon piątej generacji, a AMD nie podało w swoich przypisach żadnych szczegółów dotyczących konfiguracji platformy Intela. Niebieski zespół przeprowadził teraz benchmarki w tych samych obciążeniach AI i wygląda na to, że wyniki są radykalnie różne.

Korzystając z Intel Extension dla PyTorch (P99 Latency), procesory Emerald Rapids mogą zapewniać 5,4 razy lepszą wydajność niż to, co zaprezentowało AMD. Wydajność 686 tokenów/s przewyższa nawet wynik układów EPYC piątej generacji. Dzieje się tak nie tylko dzięki optymalizacji oprogramowania Intela dla Llama2, ale także dodanym akceleratorom sprzętowym AI w rodzinie Emerald Rapids 5. generacji, które zapewniają spory wzrost wydajności.

Intel na tym nie poprzestaje, firma stwierdza również, że w przypadku pozostałych dwóch obciążeń, tłumaczenia (Translation) i podsumowania (Summarization), firma odnotowała wzrost wydajności od 1,2 do 2,3 razy w porównaniu z wynikami, które AMD zaprezentowało w swojej prezentacji na Computex 2024.

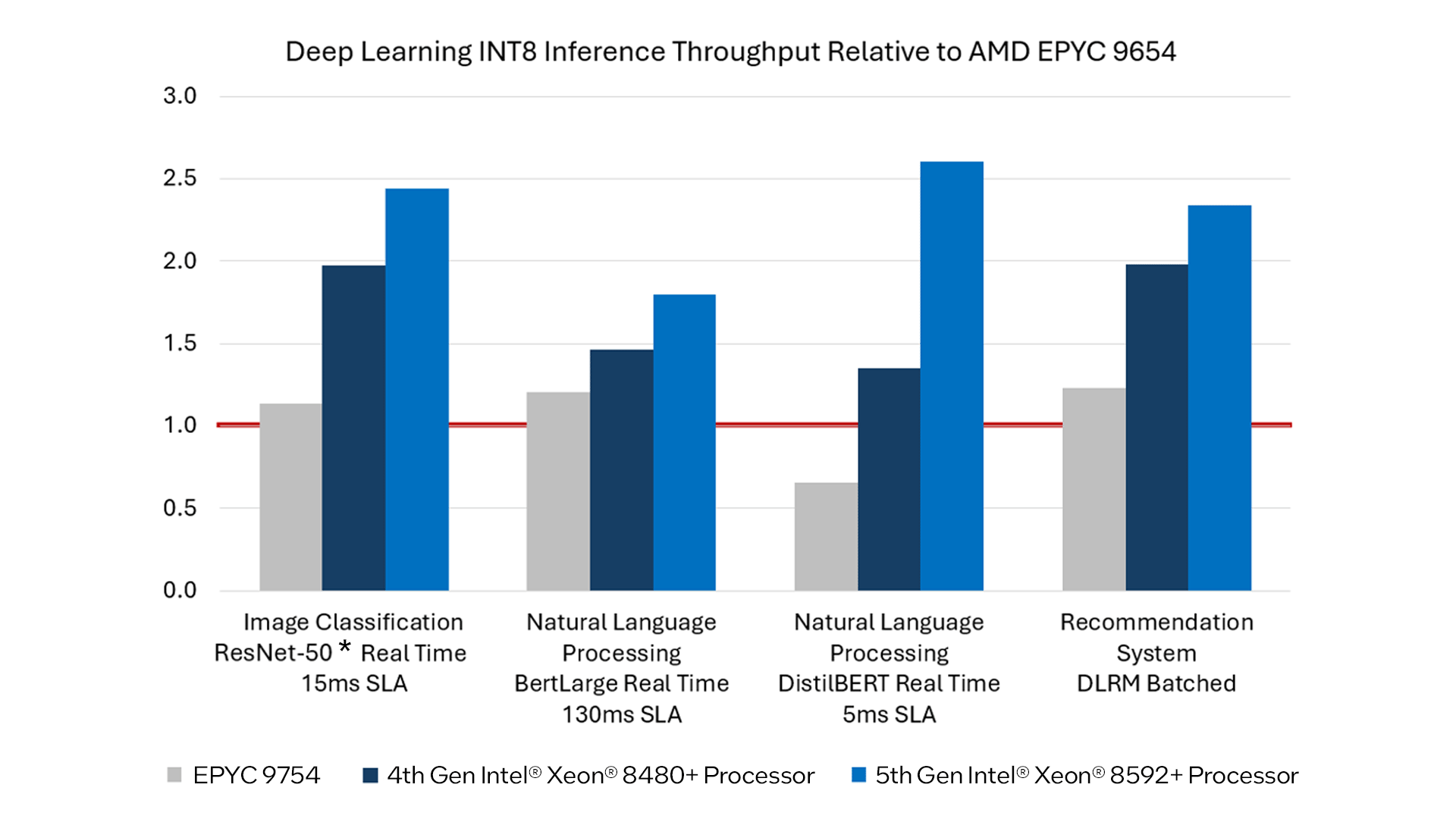

Co więcej, ważniejszym aspektem jest to, że te testy w dużym stopniu zależą od pamięci, a rodzina EPYC nowej generacji będzie wyposażona w 12-kanałowy interfejs DDR5. Podczas gdy procesory Intel Xeon „Emerald Rapids” obecnej generacji wspierają do 8 kanałów pamięci DDR5, to procesory Granite Rapids „Xeon 6700P/6900P” nowej generacji będą nie tylko wyposażone w ten sam 12-kanałowy interfejs pamięci co nowe EPYCki, ale także mają tę samą liczbę 128 rdzeni w przypadku procesorów z rdzeniami P i do 288 E rdzeni w przypadku rodziny Xeon 6900E, która pojawi się na początku 2025 r. Procesory Granite Rapids Xeon 6700P będą dostępne z maksymalnie 86 rdzeniami P w trzecim kwartale 2024 r.

Trudno dziwić się reakcji Intela, bo rynek AI jest niezwykle lukratywny i trwa zacięta walka o klientów w tym segmencie. NVIDIA i AMD również toczyły podobną batalię kilka miesięcy temu, kiedy zespół czerwonych ogłosił swoje dane MI300X, porównując je z serią Hopper, co wywołało przepychankę między firmami.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Intel odgryza się AMD. Pokazuje wyniki serwerowych CPU Xeon lepsze niż EPYC Turin