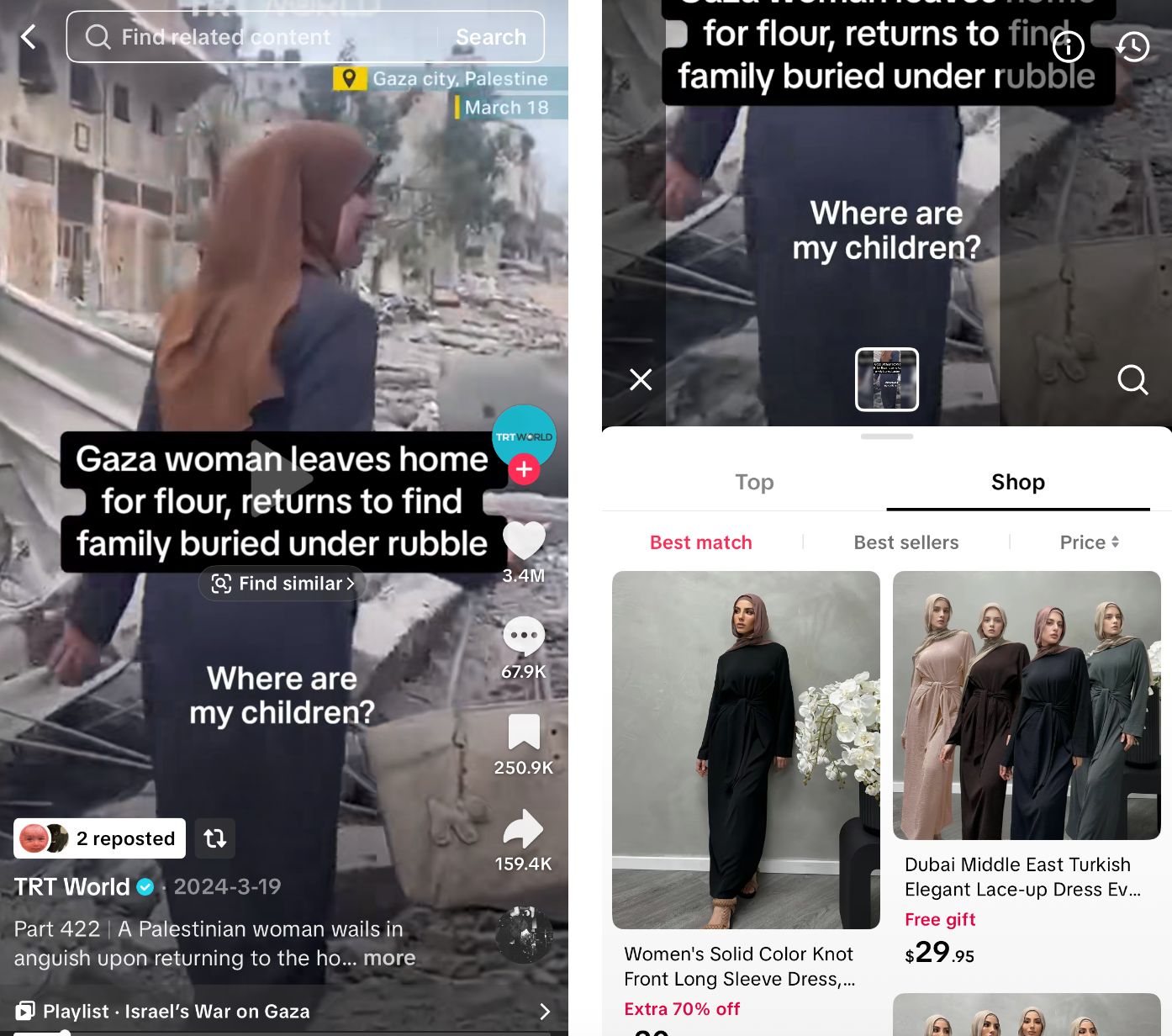

Jak donosi portal The Verge, TikTok znów znalazł się na świeczniku, po tym, jak algorytm aplikacji zaczął wyświetlać rekomendacje zakupowe w drastycznych nagraniach z Gazy. W jednym z przykładów film przedstawiający Palestynkę poszukującą członków rodziny wśród gruzów został opatrzony propozycjami zakupu sukienek podobnych do tych, które kobieta miała na sobie.

System podpowiadał produkty o nazwach takich jak „Dubai Middle East Turkish Elegant Lace-Up Dress” czy „Women’s Solid Color Knot Front Long Sleeve Dress”. Choć mechanizm został stworzony w celach komercyjnych, jego automatyczne działanie w kontekście wojny jest mocno nie na miejscu i rodzi pytania o odpowiedzialność platformy.

TikTok znów znalazł się na świeczniku, po tym, jak algorytm aplikacji zaczął wyświetlać rekomendacje zakupowe w drastycznych nagraniach z Gazy.

Jak działa nowa funkcja?

TikTok testuje rozwiązanie oparte na sztucznej inteligencji, które rozpoznaje obiekty w nagraniach. Gdy użytkownik zatrzyma wideo, aplikacja automatycznie proponuje produkty dostępne w TikTok Shop, które wyglądają podobnie do elementów widocznych na ekranie. Na razie funkcja wdrażana jest stopniowo i nie jest dostępna dla wszystkich. Aby sprawdzić, czy działa w danej wersji aplikacji, należy wstrzymać film i poszukać okienka „Find Similar”.

Brak wytycznych i reakcja TikToka

Jak zauważa The Verge, problemem nie jest sama technologia, lecz brak przemyślenia, w jakich kontekstach powinna być stosowana. Automatyczne dopasowywanie ofert handlowych do treści związanych z wojną, katastrofami czy tragediami wydaje się po prostu cyniczne i nieetyczne. TikTok na razie nie przedstawił szczegółowych wyjaśnień ani wytycznych dotyczących tego narzędzia. Redakcja, która jako pierwsza nagłośniła sprawę, czeka na odpowiedź firmy w tej sprawie.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Algorytm TikToka polecał sukienki na nagraniach z Gazy. Portal ma kłopoty