Jeśli nie śledzicie dokładnie nowości AI, to mogliście przegapić, że niezwykłą popularność zdobył ostatnio asystent o nazwie OpenClaw. Czy warto się nim zainteresować, czy to może tylko kolejna wydmuszka związana z AI?

Otóż nie, to nie jest kolejny asystent AI który robi te same, lub podobne rzeczy co inne rozwiązania. Jest to asystent autonomiczny, który działa lokalnie na komputerze użytkownika i faktycznie potrafi wykonywać realne zadania, a nie tylko odpowiadać na pytania. Mówiąc o realnych zadaniach mamy na myśli zarządzanie plikami, kontrolę przeglądarki, czy automatyzację w komunikatorach. OpenClaw może więc działać bez ciągłego nadzoru użytkownika. Żeby daleko nie szukać, za pomocą popularnego Perplexity możesz co najwyżej łączyć konta z chmurowymi magazynami (Google Drive, czy OneDrive), ale dostęp ogranicza się do odczytu i analizy plików w kontekście zapytań.

Zapowiedzi podobnych działań mieliśmy choćby ze strony Microsoftu w stosunku do Copilota, gdzie pojawiły się już szczątkowe funkcje zmian ustawień systemowych (zmiana jasności ekranu, parowania urządzeń BT, czy opróżnianie systemowego kosza), lub wyszukiwania plików. Passa Copilota jednak ostatnio nie jest najlepsza - inne rozwiązania sprawują się lepiej, a kolejne zapowiedzi Microsoftu nie budzą ani entuzjazmu, ani zaufania użytkowników.

Czym OpenClaw wyróżnia się na tle ChataGPT, Groka czy Gemini?

OpenClaw nie jest chatbotem reaktywnym - to znaczy, że potrafi działać samodzielnie, a nie tylko podejmować działania na podstawie aktualnych poleceń użytkownika. Tu wkracza mechanizm "heartbeat" - agent cyklicznie sprawdza zdefiniowaną listę zadań, a jeśli wykryję zmianę lub problem (może to nie być tylko alert systemowy, ale zaległa faktura) to inicjuje działanie - np. wyszukiwanie i raportowanie, czy synchronizację danych. OpenClaw trwale zapamiętuje kontekst, dzięki czemu uczy się preferencji użytkownika i zapamiętuje działania.

No i oczywiście w przeciwieństwie do chmurowych asystentów, działa on na komputerze użytkownika, zapewniając pełną prywatność danych i brak zależności od dostawców. Wybór modelu LLM jest praktycznie dowolny, a przy pomocy LM Studio, czy też Ollamy, możemy napędzać OpenClaw za pomocą DeepSeeka, Qwen, Llamy, czy Mistral. OpenClaw więc świetnie działa lokalnie, ale w razie potrzeby można go jednak wdrożyć na serwerach VPS lub w chmurze.

OpenClaw - jak to działa?

W praktycznie dowolnym komunikatorze - czyli możesz rozmawiać z agentem AI i wydawać mu polecenia bezpośrednio w WhatsApp'ie, Discordzie, Slacku czy Signalu. Agent AI instaluje się po prostu jako bot lub klient, paruje z komunikatorem (np. w WhatsApp za pomocą kodu QR) i już może przetwarzać twoje wiadomości w czasie rzeczywistym - zarówno na czatach prywatnych, jak i grupowych. Jego funkcjonalność poszerzają wtyczki, które umożliwiają integrację choćby z Gmail, Spotify, czy GitHubem.

Wielcy lubią OpenClaw

Technologiczni giganci szybko zareagowali na popularność OpenClaw i Intel zapowiedział optymalizację dla AI PC, chociaż stawia na rozwiązanie hybrydowe, które łączy lokalną prywatność z chmurową mocą. Wrażliwe dane (poufne dokumenty, czy transkrypcje spotkań) mają być przetwarzane lokalnie na AI PC (przy użyciu choćby procesorów Core Ultra z NPU), a dane publiczne lądować w chmurze, jeśli tylko użytkownik na to zezwoli. Wedle Intela lokalne przetwarzanie pozwoliłoby ograniczyć zużycie chmurowych tokenów o połowę.

Również NVIDIA nie przespała sprawy, szybko publikując poradnik instalacji OpenClaw do lokalnego przetwarzania na kartach GeForce RTX i DGX Spark. Na ten moment nie ma klasycznego wygodnego instalatora, który załatwiłby tę sprawę za pomocą dwóch, czy trzech kliknięć. Na początek trzeba zainstalować WSL (Windows Subsystem for Linux) w PowerShellu, następnie samego OpenClaw, sparować go z komunikatorem, pobrać i uruchomić konkretny model (za pomocą LM Studio, czy Ollamy), skonfigurować OpenClaw z LM Studio/Ollamą i… w końcu można zacząć działać. Proces instalacji jest trochę upierdliwy, ale nie jest to coś, z czym nie można sobie poradzić. Jeśli nie masz karty GeForce RTX możesz po prostu skorzystać z oficjalnego poradnika instalacji OpenClaw.

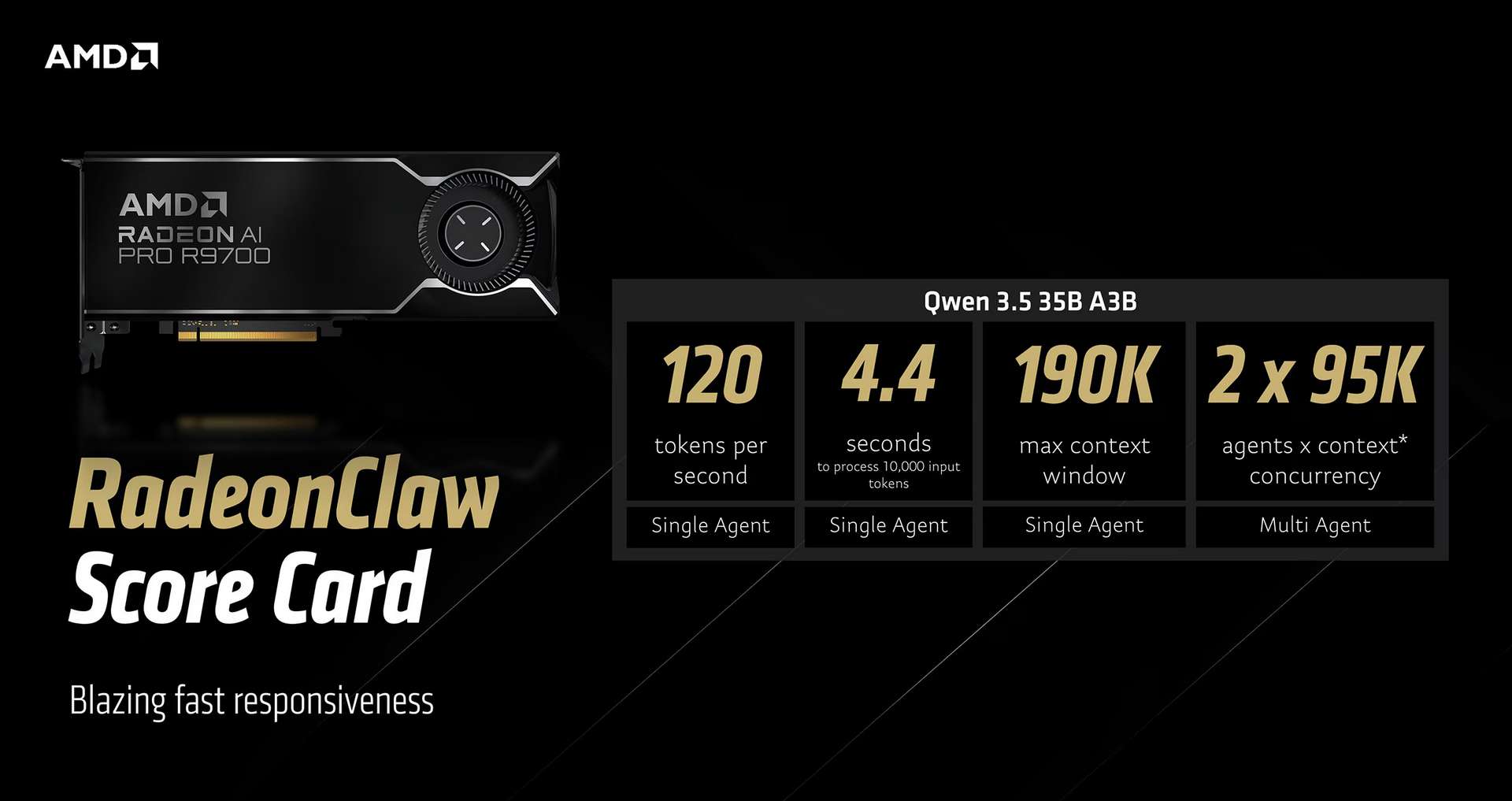

AMD też nie zasypiało gruszek w popiele i zaprezentowała dwa rozwiązania związane z OpenClaw, a mianowicie RadeonClaw - do uruchomienia lokalnie na karcie Radeon AI PRO R9700 - oraz RyzenClaw, do uruchomienia na Ryzen AI Max+ (Strix Halo) ze… 128 GB pamięci RAM (model Qwen 3.5 35B A3B). Pomysł całkiem ambitny, ale biorąc pod uwagę aktualny kryzys na rynku pamięci RAM, to chyba pozostanie w sferze ciekawostek.

OpenClaw to początek trendu ku samodzielnym agentom AI

Można by powiedzieć "w końcu!", ale oprócz licznych zalet (a wśród nich jest choćby to, że jest o projekt otwartoźródłowy), czają się tu także zagrożenia, a konkretnie ryzyko związane z bezpieczeństwem. Żeby działać taki asystent musi mieć pełen dostęp do systemu, jest tu zagrożenie związane z podatnością ataki typu prompt injection, a i zdarzają się incydenty z nieautoryzowanymi działaniami agentów, do których mogą ich zmusić złośliwe instrukcje. No i wszystko fajnie, ale koniec końców eksperci ostrzegają przed instalacją OpenClaw na wrażliwych systemach bez dodatkowych zabezpieczeń. Warto brać pod uwagę włączanie kontroli przeglądarki i systemu w trybie sandbox.

Wydawałoby się, że OpenClaw czeka świetlana przyszłość, ale… jego twórcę zdążyło już zatrudnić OpenAI. Może to oznaczać stopniowe wygaszanie projektu, a o takie funkcjonalności mogą wzbogacić się kolejne wersje ChatGPT.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

OpenClaw to pierwsza AI działająca lokalnie, która faktycznie coś robi, a nie tylko gada