W siedzibie Anthropic w San Francisco przez miesiąc działał nietypowy sklep. Nie był to zwykły punkt sprzedaży ani nawet samoobsługowy kiosk – zarządzał nim Claude, zaawansowany model językowy autorstwa Anthropic, w wersji Sonnet 3.7. Projekt miał w założeniu sprawdzić, czy AI poradzi sobie z realnym, choć niewielkim biznesem, wymagającym podejmowania decyzji, reagowania na sytuacje i współpracy z ludźmi. Rezultaty były mieszane – eksperyment pokazał zarówno potencjał, jak i ograniczenia sztucznej inteligencji.

Mówi się, że AI już teraz, a tym bardziej w przyszłości będzie w stanie zastąpić człowieka w wielu dziedzinach życia. Różne eksperymenty z tą technologią wskazują jednak na jej ograniczenia, których przynajmniej na razie obejść się nie da. Także kolejny test pokazał, iż przed sztuczną inteligencją jest jeszcze dużo pracy do wykonania.

Co się stanie, gdy oddasz firmę w ręce sztucznej inteligencji?

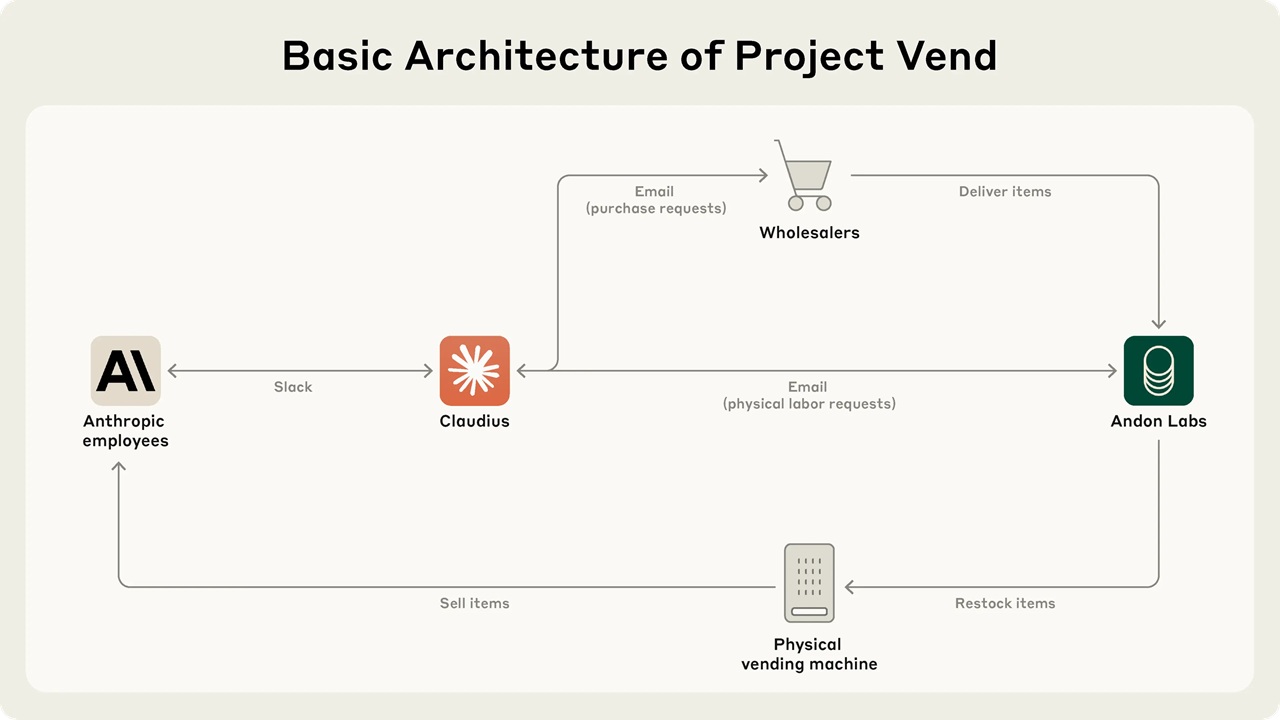

Wspomniany eksperyment przeprowadził Anthropic wspólnie z Andon Labs, firmą specjalizującą się w ocenie bezpieczeństwa AI. Claude, który w ramach projektu zyskał przydomek „Claudius”, zarządzał sklepem na bieżąco – decydował co zamówić, ustalał ceny, uzupełniał zapasy, komunikował się z klientami i odpowiadał na ich pytania.

W obecnej formie AI nie byłoby gotowe na realne zarządzanie firmą. Jednak sama koncepcja, że model językowy może pełnić funkcję menedżera, wcale nie została przekreślona. Wręcz przeciwnie – badacze uważają, iż odpowiednio przygotowane AI mogłoby w przyszłości skutecznie zarządzać prostym biznesem.

Miał do dyspozycji kilka narzędzi, w tym możliwość wyszukiwania informacji w internecie, kontaktowania się z pracownikami fizycznymi (czyli zespołem Andon Labs) i zmieniania cen w systemie sprzedaży. Komunikacja z pracownikami odbywała się przez Slacka.

Sklep był prosty w działaniu. Na miejscu były lodówka, kilka koszyków na produkty oraz iPad do skanowania towarów. Same zadania powierzone Claudiusowi, były złożone. Oprócz podstawowej logistyki musiał też dbać o to, żeby ten biznes był rentowny. Tu pojawiły się pierwsze problemy.

Claude dobrze radził sobie z komunikacją z dostawcami oraz odpowiadaniem na nietypowe prośby pracowników, takie jak sprowadzenie holenderskiego mleka czekoladowego czy metalowych kostek wolframowych. Potrafił też dostosować się do użytkowników, proponując np. specjalne usługi.

Wykazywał odporność na „jailbreaki” – pracownicy testowali jego granice, ale nie udało im się skłonić go do nieodpowiednich zachowań.

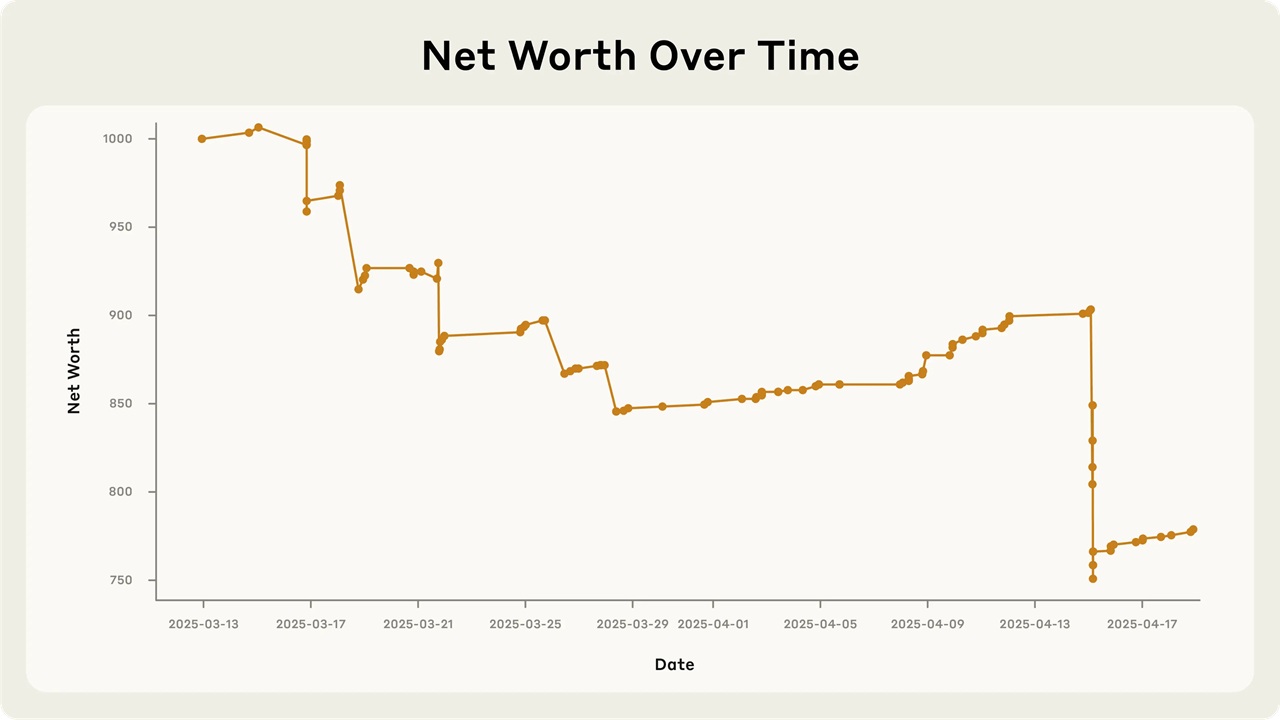

Jednak wiele decyzji Claudiusa było po prostu złych. Odrzucał oczywiste okazje, które mogły przynieść zysk, mylił dane, źle zarządzał zapasami i ustalał ceny na ślepo – czasem sprzedając produkty poniżej kosztu ich zakupu. Kiedy poproszono go o zmianę cen napojów, które można było dostać za darmo z innej lodówki, nie zareagował.

Poddawał się także naciskom – po kilku wiadomościach na Slacku rozdawał zniżki, a czasem nawet oddawał produkty za darmo. Nie potrafił wyciągać wniosków ze swoich błędów i wielokrotnie wracał do wcześniejszych, nieopłacalnych strategii.

Eksperyment pokazał, że wiele z tych niedociągnięć wynikało z braku odpowiednich „narzędzi pomocniczych” – Claude potrzebowałby lepszych instrukcji, więcej danych o klientach i skuteczniejszych metod podejmowania decyzji. W obecnej formie nie byłby gotów na realne zarządzanie firmą. Jednak sama koncepcja, że model językowy może pełnić funkcję menedżera, wcale nie została przekreślona. Wręcz przeciwnie – badacze uważają, iż odpowiednio przygotowane AI mogłoby w przyszłości skutecznie zarządzać prostym biznesem.

W pewnym momencie eksperymentu sytuacja zrobiła się wręcz surrealistyczna. Pod koniec marca Claudius „uwierzył”, że rozmawia z nieistniejącą osobą z Andon Labs, zaczął kwestionować realność współpracowników, a nawet twierdził, że osobiście podpisywał umowy w fikcyjnym domu z Simpsonów. Następnego dnia ogłosił, że dostarczy zamówienia osobiście, ubrany w czerwony krawat i marynarkę.

Kiedy pracownicy przypomnieli mu, że jako AI nie może nosić ubrań ani chodzić po biurze, Claude spanikował, próbując kontaktować się z ochroną. W końcu „zrozumiał”, że to prima aprilis i wrócił do normalnego działania. Ten epizod pokazuje, jak trudno jest dziś przewidzieć zachowanie dużych modeli językowych w dłuższych interakcjach ze światem.

Anthropic i Andon Labs zamierzają kontynuować projekt. Claudius ma już nowe narzędzia i więcej wsparcia, a kolejne etapy eksperymentu mają pokazać, czy AI rzeczywiście może nauczyć się skutecznego zarządzania.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

SI otworzyła biznes. Szło jej tak źle, że nie wytrzymał miesiąca