Google zaprezentowało nowe modele sztucznej inteligencji Gemma 4, które mają działać nie tylko w chmurze, ale także bezpośrednio na komputerach. To ważna zmiana, ponieważ coraz więcej firm stawia na lokalne AI, czyli rozwiązania, które nie wymagają stałego połączenia z internetem.

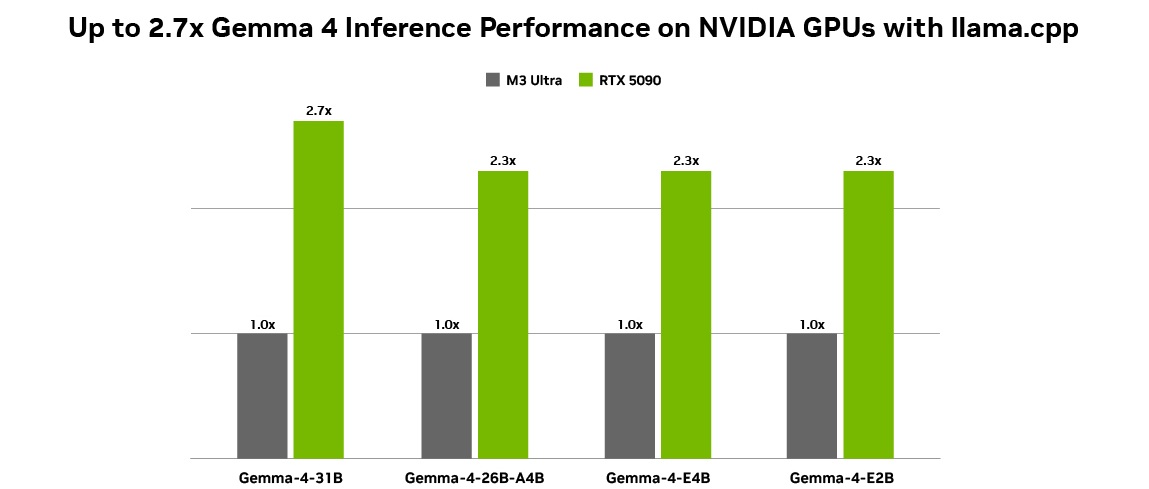

W rozwój tego projektu zaangażowana jest także NVIDIA. Współpraca obu firm ma sprawić, iż nowe modele będą dobrze zoptymalizowane pod kątem kart graficznych z serii RTX, które znajdują się w wielu komputerach domowych i stacjach roboczych. I nie da się ukryć, że są przygotowywane właśnie głównie z myślą o tych GPU.

AI coraz bliżej użytkownika

Przytoczone modele sztucznej inteligencji Gemma 4 przenoszą część obliczeń bezpośrednio na urządzenia użytkowników. Dzięki temu możliwe jest szybsze działanie przy mniejszych opóźnieniach i większa prywatność, ponieważ dane nie muszą być przesyłane na zewnętrzne serwery. Będzie to dobre rozwiązanie dla osób ceniących sobie bezpieczeństwo danych.

Google zaprezentowało nowe modele sztucznej inteligencji Gemma 4, które mają działać nie tylko w chmurze, ale także bezpośrednio na komputerach. To ważna zmiana, ponieważ coraz więcej firm stawia na lokalne AI, czyli rozwiązania działające bez potrzeby stałego połączenia z internetem.

Modele Gemma 4 zostały zaprojektowane właśnie z myślą o takim rozwiązaniu. Mają być stosunkowo lekkie, szybkie oraz dostosowane do działania na różnych urządzeniach, od małych modułów po wydajne komputery wyposażone w układy z serii RTX.

Różne warianty dla różnych zastosowań

Nowa rodzina modeli AI obejmuje kilka wersji, które różnią się możliwościami i wymaganiami sprzętowymi. Lżejsze warianty zostały przygotowane z myślą o pracy na sprzęcie o ograniczonej mocy, gdzie liczy się szybkość działania oraz niskie zużycie zasobów.

Z kolei większe modele mają oferować lepsze możliwości analizy danych, rozwiązywania problemów czy wspierania programistów. Dzięki temu mogą być wykorzystywane nie tylko przez entuzjastów, ale też w bardziej zaawansowanych projektach.

Wsparcie dla wielu typów danych

Jedną z ważniejszych cech nowych modeli jest obsługa różnych form danych. Oznacza to, iż AI może pracować nie tylko na tekście, ale także analizować obrazy, dźwięk czy materiały wideo. W praktyce otwiera to drogę do bardziej rozbudowanych zastosowań, takich jak rozpoznawanie obiektów, analiza dokumentów czy automatyczne przetwarzanie nagrań. Dodatkowo modele wspierają wiele języków.

Lokalne AI w praktyce

Dzięki optymalizacji pod karty graficzne NVIDII, modele Gemma 4 mogą działać sprawnie na komputerach wyposażonych w układy RTX. Wykorzystują one specjalne rdzenie do obliczeń związanych ze sztuczną inteligencją, co przekłada się na lepszą wydajność i krótszy czas odpowiedzi.

W praktyce oznacza to, że użytkownicy mogą uruchamiać zaawansowane narzędzia AI bezpośrednio na swoich komputerach. Takie rozwiązania mogą wspierać codzienną pracę, pomagać w pisaniu kodu czy automatyzować różne zadania.

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

Google pokazuje AI, które działa lokalnie na kartach RTX. Idzie rewolucja