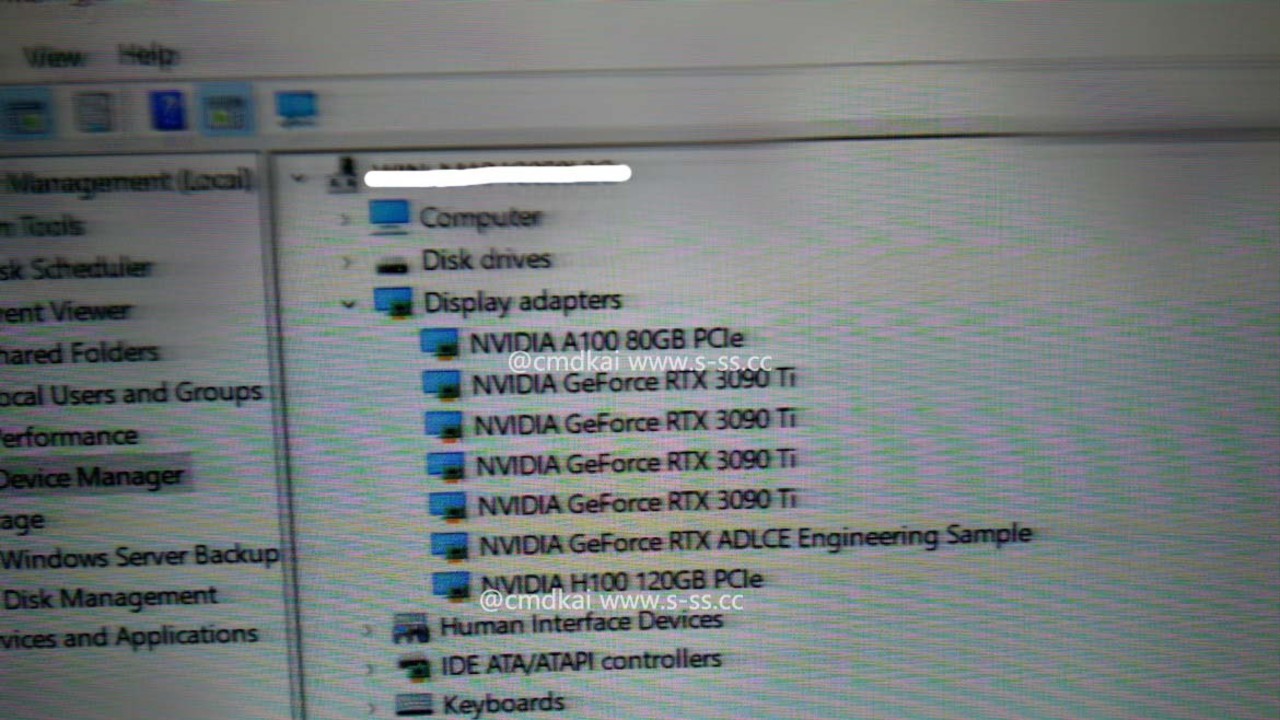

NVIDIA pracuje ponoć nad zupełnie nową wersją karty graficznej Hopper H100 na PCIe. Ofertę zielonych rozszerzyć ma model oferujący nie 80 GB, a całe 120 GB pamięci w standardzie HBM2e. Wariant Hopper H100 120 GB z obsługą interfejsu PCIe ma taką samą specyfikację, jak wersja SXM5.

Do tej pory NVIDIA ogłosiła oficjalnie dwa warianty karty graficznej Hopper H100: płytkę SXM5 oraz wersję PCIe. Oba rozwiązania korzystają z innej konfiguracji. Mimo, że dysponują tą samą ilością pamięci (80 GB), to SXM5 wykorzystuje nowy standard HBM3, podczas gdy wersja PCIe oferuje moduły HBM2e. Pogłoski mówią, że NVIDIA może pracować nad jeszcze jednym wariantem karty graficznej Hopper H100 z obsługą interfejsu PCIe. Ten ma ponoć dysponować znacznie większą ilością pamięci, bowiem na pokładzie znajdować ma się aż 120 GB HBM2e. Jak wskazują dostępne w sieci informacje, Hopper H100 na PCIe ze 120 GB pamięci ma taką samą konfigurację rdzenia, jak wersja SXM5. Mówimy zatem o łącznie 16 896 rdzeniach CUDA i przepustowości pamięci przekraczającej 3 TB/s. Jeśli chodzi o wydajność obliczeniową pojedynczej precyzji, tą ustalono na 30 TFLOPs, czyli dokładnie tyle samo, co w przypadku SXM5.

Nowe doniesienia wskazują, że NVIDIA może pracować nad jeszcze jednym wariantem karty graficznej Hopper H100 na PCIe. Ten model miałby oferować aż 120 GB pamięci w standardzie HBM2e.

Jeśli chodzi o specyfikację procesora graficznego GH100, to ten oferuje 144 jednostek SM. Każdy SM składa się z kolei z maksymalnie 128 jednostek FP32. W sumie mamy zatem 18 432 rdzeni CUDA. NVIDIA ogłosiła podczas GTC 2022, że GPU Hopper jest już w fazie produkcji, a pierwsze partie mają pojawić się w przyszłym miesiącu.

Jeśli wydajność jest faktycznie zauważalnie wyższa, wersja ze zwiększoną ilością VRAM trafi najpewniej niedługo do klientów Tak duża ilość pamięci bez wątpienia zostanie wykorzystana w zastosowaniach, do których te karty graficzne został stworzone. Niemniej jednak 120 GB i to w standardzie HBM2e zdecydowanie robi wrażenie.

Zobacz także:

- Radeon RX 6800 XT wydajniejszy od GeForce'a RTX 3090 Ti? Wszystko dzięki Radeon Monster Profile

- Upadł kolejny gigant kryptowalutowy. Tym razem to ogromna farma

- Samoloty hipersoniczne na węgiel. Chińscy naukowcy ogłaszają sukces w testach

Spodobało Ci się? Podziel się ze znajomymi!

Pokaż / Dodaj komentarze do:

NVIDIA pracuje ponoć nad GPU Hopper H100 ze 120 GB pamięci HBM2e